Искусственный интеллект

Наткнулся на интересное видео

В нем показали, что могло бы быть, если бы зум на камере улавливал еще и звук.

Начал думать. "А автор просто нашел в интернете подходящие звуки и добавил их на монтаже, давал ИИ картинку, просил описать, что там происходит и генерировал звуки или просто создавал их по фрагменту видео?" 🤔

А потом начал думать еще дальше, такую технологию ведь действительно реально будет внедрить в скором времени. Как раз таки одним из способов, описанным выше. Чтобы во время зума, ИИ, улавливал картинку и подставлял предполагаемые звуки.

Вопрос в том, какую нагрузку на процессор это бы создавало? Но, зум с улавливанием звука точно бы стал достойным нововведением в смартфонах, в сравнении с тем, что пытаются впихнуть.

И еще один вопрос мне не дает покоя. Где сняли такое количество одновременно проходящих концертов?

Редизайн с AI за 1 минуту

Готовлю к релизу простенький помодоро аппчик для Telegram Mini Apps. Решил, что на текущий голый дизайн нужно натянуть что-то поинтереснее.

С помощью Claude 3.5 Sonnet за одну минуту сделал редизайн на основе референса. Дизайн аппчика сверстан через CSS, поэтому ЛЛМка делала редизайн полностью кодом на основе референса. И вот, что получилось (см. картинку).

Промпт:

redesign the app according to this reference style visually (colors, fonts, buttons and etc.)

Нейросеть LivePortrait

Недавно была представлена инновационная нейросеть LivePortrait, которая способна создавать удивительно реалистичные видео, имитируя мимику и позу головы на основе одного единственного изображения. Этот прорывной инструмент открывает новые возможности для создания контента, позволяя оживлять статичные изображения и превращать их в динамичные и выразительные видео.

Более подробно про нейросеть можно прочитать тут https://hubai.ru/2024/07/09/liveportrait/

GEN-3 умеет генерировать текст

Топ-3 бесплатных курсов по нейросетям. Учимся работать с ведущими нейросетями - GPT, Midjourney, DALLE-3, Gemeni

Сейчас очень много рекламы курсов по нейросетям. Есть как платные так и бесплатные, продолжительные и короткие.

Мы провели анализ и выбрали несколько бесплатных и краткосрочных курсов, которые позволят за 1-5 дней изучить основы самых востребованных на сегодняшний день нейросетей таких как GPT, Midjourney, DALLE-3, Gemeni и других.

Данные курсы обеспечат начальную базу знаний, необходимую для заработка и определения наиболее подходящего направления для вас.

Бесплатные и краткосрочные курсы по нейросетям:

Освоите 3 нейросети, выполните реальные проекты высокого уровня и составите план получения дохода с помощью нейросетей за 5 дней.

Подробности:

Бесплатный курс, Длительность — 5 дней;

Охватывает три типа нейросетей — текстовые (GPT), графические (Midjourney) и музыкальные (Suno)

Легкость освоения

Подарки в виде полезных материалов за регистрацию.

Обучение нацелено на приобретение навыков заработка с помощью нейросетей.

Подробности:

Бесплатный курс; Длительность — 3 дня;

Охватывает две самые популярные нейросети — GPT и Midjourney;

Подходит для новичков;

Подарки после регистрации. Получите гайд с 10 способами заработка на нейросетях.

Сертификат по окончании

Курс направлен на повышение продуктивности в выполнении всех заказов на фрилансе. Организаторы обещают, что Вы сможете выполнять задачи в 50 раз быстрее.

Подробности:

Бесплатный курс; Длительность — 2 дня;

Доносимая информация основывается на практических знаниях;

Подходит для новичков. Разбираются основы работы с текстом, изображениями и видео;

Дают подарки в виде полезных материалов за регистрацию;

Если было полезно, подписывайтесь на блог. Заранее спасибо!

Всем удачи в обучении!

Робот совершил самоубийство

Сегодня у нас на повестке дня необычная история из мира нейросетей и робототехники, которая вызвала немало обсуждений и улыбок. Оказывается, даже железные помощники не выдерживают современных нагрузок на работе!

В технологичной Южной Корее зафиксирован первый в истории страны случай, когда робот, похоже, совершил самоубийство на работе. Да, вы не ослышались! Рутинная возня с документами настолько довела железного трудягу, что он решил сброситься с лестницы в городском совете Видимо, даже роботы иногда чувствуют, что их работа "не по маслу".

Что произошло?

Как рассказал в шутливой статье британский таблоид Daily Mail, неординарный инцидент произошел в городском совете Гуми, где трудился робот-госслужащий. Машина получила несовместимые с дальнейшей эксплуатацией повреждения при падении с лестницы. Причем в муниципалитете полагают, что это не было случайностью. Один из чиновников отметил, что перед происшествием робот "кружил на одном месте, как будто там что-то было". Похоже, он искал лучший угол для прыжка!

Что сподвигло отчаявшегося робота пойти на столь радикальный шаг – остается загадкой. Инженеры пытаются разобраться, но мировые СМИ уже шутят, что, возможно, он устал от недооцененной роли "электровеника" на побегушках. Известно, что робот вкалывал без перерывов с 9 утра до 6 вечера, а были ли у него выходные – история умалчивает. И кто сказал, что железным помощникам не нужны отпуска?

Этот робот-помощник был уникальным: он мог пользоваться лифтом, работал на разных этажах, доставлял документы и информировал население по важным поводам. Об износе изделия говорить не приходится – этому "терминатору" на момент инцидента исполнился всего лишь год, а его "папой Карло" является калифорнийский стартап Bear Robotics.

Вот такая история. Даже роботы не всегда выдерживают современные нагрузки на работе. Может, пора пересмотреть наши ожидания от железных помощников? Кто знает, что еще они могут нам показать, если дать им немного больше времени для "перезагрузки".

Новость об этом.

Что думаете об этом?

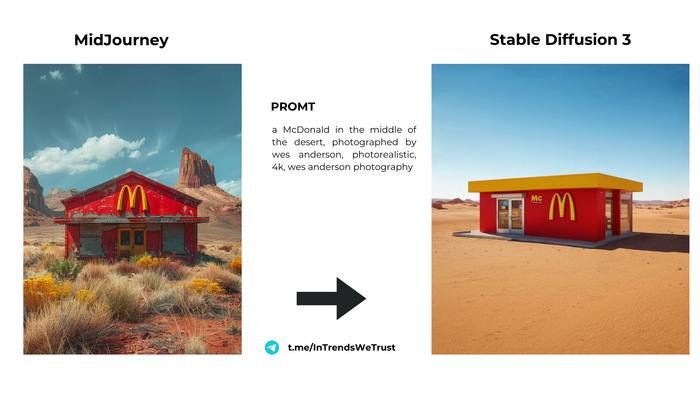

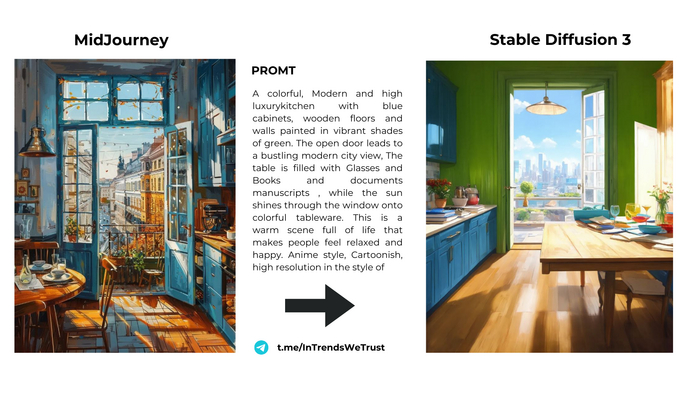

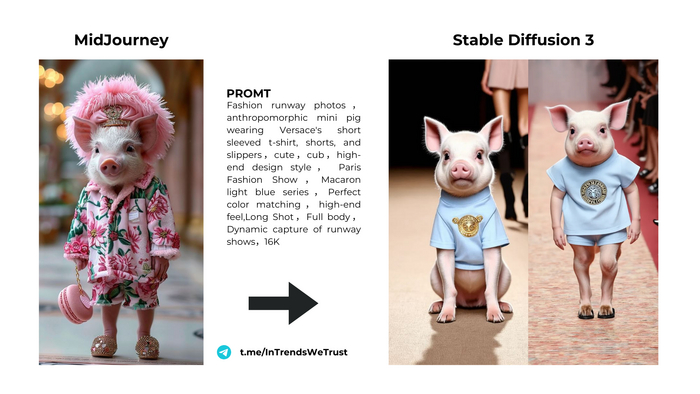

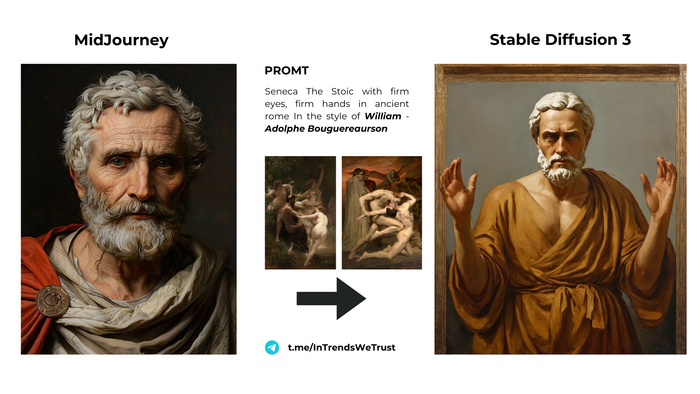

Как без регистраций и установок генерировать изображения в Stable Diffusion 3

Продолжаю цикл постов про нейронки, которые могут пригодиться.

Сегодня поговорим про Stable Diffusion 3.0, которая вышла не так давно и уже успела стать предметом обсуждений. Да, важно оговорится, модели SD можно разворачивать на собственном устройстве и делать это довольно просто, но я предпочитаю пользоваться в текущем варианте версиями, представленными на Hugging Face https://huggingface.co/stabilityai/stable-diffusion-3-medium (в правой части экрана, при открытии сайта у вас будет доступно множество пользовательских билдов).

Одна из интересных SD3 With VLM And Prompt Enhancer. VLM — с Promt Enhacer поможет распознать референс и составить по нему промт, разумеется стиль он за вас не угадает, но облегчить задачу может.

Сам я для генераций в примерах данного поста использовал самую базовую модель.

Все просто, заходим на HG, выбирая любую нужную модель SD 3 — пишем промт и жмем Run — получаем генерацию.

Плюсы:

— одна из последних опенсоурс моделей Text-to-image на быстром оборудовании бесплатно воплощает ваши фантазии в Webp-картиночки;

— есть библиотеки пользовательских моделей, которые можно исследовать и подбирать под свои задачи;

— все это в браузере, и реально: без смс и регистраций даже.

Минусы:

— все еще не MJ даже предпоследнего поколения по качеству картинок;

— так как разворачиваетесь вы на чужом оборудовании и используете чужие билды, никто не гарантирует их долгое существование, но благо там вариантов много.

— web-версия модели не позволяет адаптировать ее и улучшить качество генераций за счет доработок билда.

Мнение:

Я попробовал генерации сравнить с MJ, да, разница огромна. Но, что интересно, где-то отдельные детали тот же SD понимает гораздо лучше MJ, например, стилистику картины Вильяма Бугро MJ слажала, так как у нее ближе к фотореализму, в то время как у SD было чуть более точнее.

Но по деталям и стилизации, понятно, что до MJ далеко, однако: всему свое время. Да и некоторые кастомные модели улучшают качество генераций в несколько раз, стоит поискать.

Взято из канала Верю только трендам. Там пишу больше о Digital, ИИ и маркетинге. Рассказываю как применять инструменты ИИ платные и бесплатные в работе. Буду рад видеть.

Эпохи развития генерации видео

Мифологические времена

Генерация изображений долгое время была мечтой. Сначала это делали GAN-сети, но позже появилась более совершенная технология "Diffusion". Первые сгенерированные изображения были ужасающими. Ничего стабильного, ничего правильного, но при этом отдаленно похоже на живое. Если вам не нравится, когда на AI-картинке по шесть пальцев на руках, то на первых сгенерированных изображениях неправильно было вообще всё.

О генерации видео тогда никто даже не заикался.

Пещерный период

В 2022 году модели генерации изображений стали выдавать первые приемлемые результаты и начали привлекать внимание. Почти сразу же появились и первые идеи по генерации видео. Но о генераторах видео мало писали, ведь результаты были очень далеки от идеала.

Одной из реально работающих сетей была китайская нейросеть CogVideo (2022). Вот пример видео, сгенерированного этой сетью:

Видео, сгенерированное мной в сентябре 2022 года

Бронзовый век

В 2023 появилась тоже китайская нейросеть AnimateDiff (2023). Сейчас её стало возможно запустить в "пространстве Zero": AnimateDiff на Hugging Face.

На примере AnimateDiff хорошо видно, как устроены сети генерации видео - они состоят из двух моделей. Одна отвечает за движение объектов в кадре, а другая генерирует кадры, используя предыдущий кадр в качестве образца и задачу от модели движения.

Примеры видео, сгенерированных мной в 2023 году в AnimateDiff:

Человек собирает грибы

Чёрный кот есть пирожные

Античность

В начале 2024 года Stable Video представила генератор видео, который мог генерировать видео, представляющие художественный интерес. Первые видео, выложенные в моём блоге, были сделаны именно в Stable Video. Плюсы: это уже можно было смотреть. Минусы: анимация была странной и некрасивой.

Примеры видео:

Старинный зал

Акула

Средние века

С марта 2024 сервис генерации видео предоставил Haiper. Он был изначально бесплатен, что привлекло много пользователей.

Плюсы: Происходящее в кадре стало более "живым" за счёт быстрых движений. Минусы: логотип Haiper постоянно был в кадре (как выяснилось, совершенно напрасно, как раз тогда, когда Haiper, наконец сделал платные тарифы, убирающие логотип, появились более продвинутые сети и про Haiper все забыли 😂). Также скорость происходящего на видео часто превышала возможности генератора, что приводило к сбоям.

Нуарное сотворение вселенной

Аквариум

Возрождение

В апреле-мае 2024 получила распространение RunWayML Gen-2.

Плюсы: видео начали получаться красивыми и адекватными. Минусы: всё ещё недостаточная скорость движения происходящего в кадре.

Примеры видео:

Поход за грибами

Музыкальные инструменты под водой

Новое время

Май-июнь 2024: Luma.AI. Эта нейросеть начала "оживлять мемы" и делать другие шутливые вещи.

Плюсы: движение в кадре стало быстрым и естественным. Минусы: предметы часто "превращались в непонятное" (морфинг).

Примеры видео:

Алые паруса

Ромб

Новейшее время

Июль 2024: сервис RunWayML Alpha Gen-3. Немного сыроватый, выпущенный "как есть", чтобы перебить интерес к LumaAI. Однако технически уже превосходит Luma. Главная возможность - генерация видео до 60 секунд (через продление генерации).

Пример видео:

Шторм на Марсе

Ускорение смены эпох вызвано знаменитым роликом-демонстрацией работы нейросети Sora от OpenAI "Air Head":

Sora так и не была выложена в общий доступ, а работа с ней оказалась сложной. Подробнее о проблемах с Sora можно прочитать здесь. Для ролика с шариком потребовалось много попыток и серьёзная пост-обработка. С таким уровнем пост-обработки и в Stable Video можно было бы сделать что-то подобное.

Поэтому можно уверенно сказать, что RunWayML Alpha Gen-3 достиг уровня Sora (в том числе и по возможной длительности ролика - до 1 минуты). А может быть даже и перегнал.

Заключение

В конце немного о моём канале: я давно слежу за генерацией видео и хотел создать канал с творческой генерацией. Это не обучающий канал, а именно канал с результатами работы. Поэтому у меня часто были объединены работы разных генераторов, придуман осмысленный сюжет и добавлено озвучивание.

Я очень благодарен зрителям, с которыми мы вместе прошли весь этот путь совершенствования видео от Античности до Новейшего времени. В некотором смысле считаю свою задумку выполненной. Пока новые видео не планирую больше делать, кроме как когда появится новый технологический период и мы перейдём в будущее 😇