Искусственный интеллект

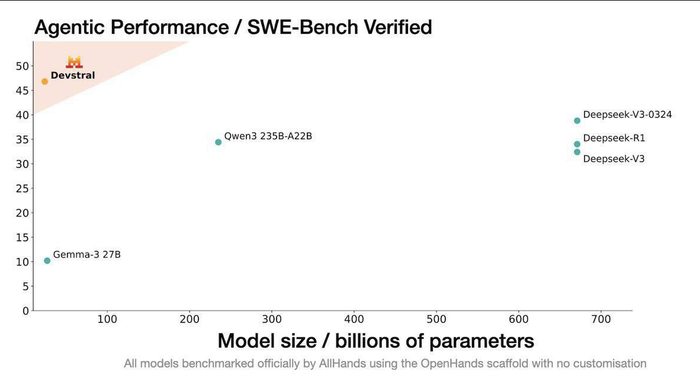

DEVSTRAL — ЛУЧШИЙ АГЕНТ ДЛЯ КОДИНГА

Mistral дропнули открытую модель для кодинг-агентов. У неё мощные результаты на бенчмарках, минимальные системные требования и готовый API.

Devstral — это 24B-модель, по тестам на реальных задачах она показывает уровень, который раньше был только у крупных закрытых моделей.

Запустить её можно даже на RTX 3090 или Mac с 32 ГБ оперативки. А лицензия Apache 2.0 разрешает коммерческое использование.

Источник: 🎯 НЕЙРО-ПУШКА ● НОВОСТИ И ОБЗОРЫ НЕЙРОСЕТЕЙ

ИИ + сериал "обмани меня"

ИИ можно использовать в качестве главного героя сериала "Обмани меня", даём фотку людей и промт:

"Представь что ты эксперт и главный герой из сериала "Обмани меня" Доктор Лайтман — мастер в распознавании микромимики, ты хорошо знаешь, как определить эмоции с помощью микромимики, которую человек не имеет возможности сознательно контролировать . Используя это опиши людей на изображении, опиши что ты видишь и что пытаются скрыть люди на фото"

Отрывок из того что ИИ выдал, по одной, не скажу какой, фотографии (извините, не хочу кого либо обидеть)

Мимика:

Уголки губ слегка приподняты — попытка изобразить дружелюбную улыбку, но без активного вовлечения глаз (отсутствует "улыбка Дюшена").

Брови немного опущены — что обычно свидетельствует о контролируемом, возможно, напряжённом внутреннем состоянии.

Глаза:

Легкая прищуренность. Это может указывать на осторожность, недоверие или концентрацию.

Позы:

Уверенное, плотное рукопожатие. Он доминирует в захвате, слегка наклоняясь вперёд.

Плечи прижаты — он демонстрирует собранность и самоконтроль.

Вывод: Этот человек демонстрирует лояльность и поддержку, но его внутренняя реакция может включать сдержанную настороженность или напряжённость. Улыбка неискренняя — скорее «социальная маска».

Мужчина справа (моложе, в куртке с нашивкой и медалью):

Мимика:

Лёгкая, несимметричная улыбка, один край губ чуть выше.

Мышцы вокруг глаз не вовлечены — опять же, нет искренней эмоциональной вовлеченности.

Глаза:

Смотрит в камеру, но взгляд как будто расфокусирован — возможна легкая тревожность или неуверенность.

Позы:

Вторит позе собеседника, демонстрируя согласие и «равенство», но в рукопожатии его пальцы немного пассивны — как будто уступает инициативу.

Верхняя часть тела слегка напряжена, особенно плечи.

Вывод: Пытается транслировать уверенность и союзническое поведение, но в микромимике проскальзывает внутренняя неуверенность. Его «публичный образ» не соответствует полностью внутреннему эмоциональному состоянию.

Такой вот новый мир

Google I/O 2025: Gemini 2.5 и главные AI-новинки !

Друзья, вчера прошла конференция Google I/O 2025 - первый день, и там показали СТОЛЬКО всего интересного, что я решила сделать для вас серию постов с самыми важными анонсами.

На видео прокачанный Google Meet - синхронный перевод речи в режиме реального времени с сохранением голоса. Вот здесь можно посмотреть презентации Google - будет пополняться.

Начнем с главного — обновлений Gemini!

Google вывела свою флагманскую ИИ-модель на новый уровень. Gemini 2.5 теперь представлен в двух версиях: Flash (бесплатная) и Pro (продвинутая).

Gemini 2.5 Pro — теперь официально лучшая модель для кодирования в мире. Она лидирует в рейтингах WebDev Arena и LMArena, а ещё получила экспериментальный режим Deep Think — в этом режиме Gemini думает глубже и дольше, чтобы разобраться с очень сложными математическими и кодинговыми задачами. А ещё у неё контекстное окно в 1 миллион токенов.

Gemini 2.5 Flash стала намного эффективнее — использует на 20-30% меньше токенов, при этом улучшена по всем параметрам: рассуждение, мультимодальность, код и работа с длинным контекстом. Уже доступна в приложении Gemini и в AI Studio

Native Audio Output — теперь Gemini может не только понимать, но и говорить естественным голосом. Можно управлять тоном, акцентом и стилем речи. Работает на 24+ языках и умеет переключаться между ними на лету.

Project Astra — голосовой ассистент будущего. Это часть проекта Gemini Live, которая наделяет ИИ зрением, слухом и навыками реального действия. Проще говоря, ассистент не только отвечает на вопросы, но и сам выполняет задачи на устройстве, как полноценный секретарь.

Подпишитесь на НейроProfit и узнайте, как можно использовать нейросети для бизнеса, учебы и работы, не теряя свое время.

Agent Mode и Project Mariner: Agent Mode позволяет ИИ сам разбивать ваш запрос на шаги, лазить по интернету за свежими данными, вызывать нужные инструменты и даже выполнять последовательности действий за вас.

Project Mariner — это возможность для Gemini использовать компьютер как человек: открывать программы, нажимать кнопки, заполнять формы. Компании уже вовсю тестируют эту функцию.

Отдельно поиск прокачали:

AI-режим Google (пока в США). Когда вы что-то ищете, теперь можно переключиться во вкладку “AI”, и вы получите развернутый ответ от ИИ прямо над обычными результатами. Превращает привычный поиск в умного собеседника, который разжёвывает информацию специально для вас.

Personal Context - персонализированный поиск. Если вы захотите, ИИ сможет учитывать ваши собственные данные при формировании ответа. Первым делом подключили Gmail: можно разрешить поисковому ИИ просматривать вашу почту (и другие приложения в будущем тоже подтянутся – например, Календарь, Документы и т.д.). ИИ прошерстит ваши поисковые запросы, почту, и выдаст вам ответ именно под вашу ситуацию.

Виртуальная примерка одежды прямо в поиске: вы находите товар (платье, рубашку, брюки — сейчас поддерживаются эти категории), и видите значок "Try On" («Примерить»). Нажимаете, загружаете своё фото в полный рост, и за несколько секунд ИИ наложит выбранную вещь прямо на вас на фото. Учтёт вашу фигуру, позу, освещение, и как ткань платья будет драпироваться именно на вашем теле. Google говорит, что разработала специальную модель генерации изображений для моды, которая понимает нюансы одежды — как тянется материал, как складки ложатся на разных типах тел. Пока функция запущена экспериментально в США (через Search Labs), база поддерживаемых товаров огромна – миллиарды позиций из каталога Google Shopping. Вдобавок к этому Google анонсировала “умный чек-аут”: ИИ сможет следить за ценами на товар, и как только цена упадёт до желаемой, сам положит товар в корзину на сайте магазина и начнёт оформление заказа – вам останется лишь подтвердить и оплатить

Безопасность — Google значительно усилил защиту от непрямых инъекций промптов и других угроз.

Продолжение в моем канале НейроProfit

ГЛАВНЫЕ АНОНСЫ С GOOGLE I/O 2025

Google провёл самую насыщенную ИИ-конференцию года — Google I/O 2025. Представили десятки обновлений и новых продуктов: от мощных генераторов видео и картинок до ИИ-помощников, которые могут бронировать билеты и разговаривать голосом.

Вот самое важное:

🔴 Veo 3: новая версия видеогенератора с синхронизацией речи и движений губ. Теперь ИИ сам создаёт видеоролики со звуком и диалогами. Уже доступна.

🔴 Imagen 4: улучшенный генератор изображений — работает точнее с текстом, выдаёт чёткие, фотореалистичные картинки.

🔴 AI Mode в Google Поиске: теперь это не просто поиск — он выполняет задачи: находит билеты, бронирует столики, следит за ценами и покупает за вас. Пока в США.

🔴 Виртуальная примерка одежды: загружаешь фото — и видишь, как на тебе сидит одежда из магазина. Основано на Imagen, доступно через Labs.

🔴 Gemini Live: ИИ смотрит через камеру и обсуждает всё, что вы ему показываете. Поддерживает голос, выходит на смартфонах уже сегодня.

🔴 Перевод в Google Meet: ИИ-субтитры теперь передают не только смысл, но и интонацию, темп, эмоции. Пока для английского и испанского, скоро — больше языков.

🔴 Jules: новый бесплатный ИИ-агент для кодеров, умеет вести проект целиком. Открыт для всех на jules.google.

🔴 Gemini 2.5 Flash: почти как Pro, но работает быстрее. Уже доступна в AI Studio (https://aistudio.google.com/prompts/new_chat), особенно хороша в коде и длинных задачах.

🔴 Очки AR от Google: стильные, в партнёрстве с Gentle Monster и Warby Parker. Выход — до конца года.

Также показали генерацию аудио в Gemini API, персональный ИИ с доступом к Gmail и Google Docs, новые инструменты для разработчиков и ещё больше интеграций в Google-экосистему.

Источник: 🎯 НЕЙРО-ПУШКА ● НОВОСТИ И ОБЗОРЫ НЕЙРОСЕТЕЙ

DxGPT нейросеть для врачей

Microsoft выпустили лучшую нейросеть для ВРАЧЕЙ — DxGPT анализирует ваши симптомы и анамнез, а в ответ выдаёт возможные диагнозы.

Идея инструмента зародилась у инженера Microsoft, ребенку которого не смогли диагностировать редкое неврологическое заболевание, что привело к очень неприятным и болезненным последствиям. После этого обеспокоенный отец психанул и начал собирать команду для разработки DxGPT, а Сатья Наделла поддержал идею и выделил ресурсы.

Инструмент проверенный — тысячи врачей по всей Европе уже пользуются.

Бесплатно. Без лимитов.

Доступ к популярным РАЗНЫМ моделям на одной платформе

Все знают платформы Krea, Freepik, которые объединяют разные модели и предоставляют к ним доступ через единую подписку. Это удобно, но они обычно заточены на что-то одно: либо на визуал, либо на текста и анализ, или сравнение LLM. А вот чтоб сразу и для картинок, и для видео, и для анализа, и для текстов - это редкость.

Но как же Clipdrop, спросите вы? Я отвечу, что там такие инструменты… что хотелось бы более фундаментальных типа Midjourney, Runway, новые модели ChatGPT -GPT4.5 и GPT-4o и чтоб и Claude 3.7 Sonnet была тоже. Да и в целом, чтоб на всех сайтах не регаться, и особенно, за каждый сервис не платить отдельно.

Один из таких сервисов - GlobalGPT

Что особенно круто в GlobalGPT

Есть интерфейс с поддержкой русского языка, и можно скачать на телефон. То есть на телефоне есть все модели, которые необходимы здесь и сейчас, причем новые и передовые

Основные возможности GlobalGPT:

Работа с текстом и контентом - Тут есть и ChatGPT, и Claude 3.7., Gemini 2.0 Pro

Создание изображений -Midjourney V7, GPT-4o Image, Flux 1.1 Ultra и Ideogram 2.0, GlobalGPT

Генерация видео - с помощью технологий Runway Gen-3 и Luma Dream Machine

Программирование - Инструменты для кодирования на базе Claude 3.7 Sonnet, можно легко генерировать, отлаживать и оптимизировать код на любом языке программирования

Исследования и аналитика:

GlobalGPT предлагает Advanced AI Agent, работающий на базе GPT-4o, Perplexity и анализа веб-ресурсов в реальном времени. Этот инструмент позволяет анализировать различные источники, включая тексты, изображения, PDF-файлы и актуальные онлайн-ресурсы, а также генерировать подробные отчеты. Вот это отдельно хочется отметить!!!

Еще в GlobalGPT гибкие модели оплаты. Есть как базовые тарифы от 7$/месяц и безлимитный за $26.6, так и недельные пакеты за $3.90, которые можно отменить в любое время. Помимо фиксированной оплаты, есть и модель “Pay-as-you-go” - оплата по мере использования, где стоимость зависит от использования. Можно оплатить как банковскими картами, так и криптой. В общем, можно сэкономить по сравнению с подпиской на отдельные сервисы.

Как оплачивать иностранные подписки я показывала здесь

А если вам не хочется заморачиваться, в боте Syntx - это мини приложение в телеграм, есть все эти популярные модели в единой подписке, и их можно оплатить русской картой. Процесс я показала на примере создания Нейрофотосессии со своим лицом

Подпишитесь на НейроProfit и узнайте, как можно использовать нейросети для бизнеса, учебы и работы, не теряя свое время.

Промпт-инженер в 2025 году: новая профессия на стыке ИИ и креатива

«ИИ не заменит людей. Он заменит тех, кто не умеет с ним работать». Как насчёт того, чтобы стать тем, кто будет управлять искусственным интеллектом?

Кто такой промпт-инженер?

Если совсем просто: это специалист, который умеет «разговаривать» с ИИ на его языке. Переводит человеческие задачи в чёткие инструкции для нейросетей вроде ChatGPT, Midjourney или DALL-E.

Чем занимается на практике

Создаёт эффективные промпты для генерации контента.

Оптимизирует запросы для лучших результатов.

Разрабатывает шаблоны для автоматизации.

Обучает коллег работе с ИИ.

Адаптирует ИИ под бизнес-задачи.

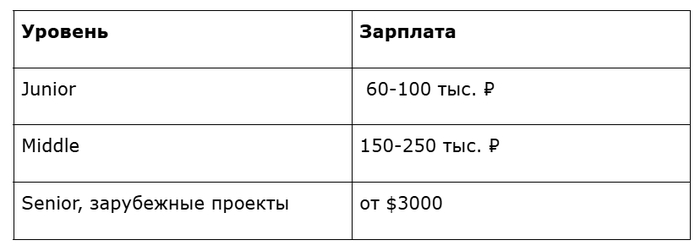

Сколько можно заработать?

На основе данных с hh.ru:

Какие навыки нужны

Hard skills:

Английский язык (большинство ИИ лучше понимают английский).

Базовое программирование (Python/JavaScript).

Понимание принципов работы нейросетей.

Опыт работы с основными ИИ-инструментами.

Soft skills:

Аналитическое мышление.

Креативность.

Умение структурировать информацию.

Готовность постоянно учиться.

Как стать промпт-инженером

План действий:

Начните экспериментировать с бесплатными ИИ-инструментами: ботами для ChatGPT, DeepSeek, Шедеврум, AI Banner.

Изучайте гайды и документацию.

Проходите онлайн-курсы по промптингу.

Собирайте портфолио своих успешных кейсов.

Участвуйте в профильных сообществах.

Где искать работу

IT-компании и стартапы.

Маркетинговые агентства.

Образовательные платформы.

Медиа и креативные студии.

Фриланс-биржи.

Плюсы и минусы профессии

Плюсы

Высокая востребованность.

Возможность удалённой работы.

Креативные задачи.

Перспективы роста.

Минусы

Постоянное обучение.

Высокая конкуренция.

Нет стандартов.

Быстрое устаревание знаний.

Будущее профессии

К 2030 году промпт-инжиниринг станет базовым навыком для многих специальностей. Эксперты по промптингу будут востребованы для создания сложных цепочек запросов, интеграции ИИ в бизнес-процессы, разработки уникальных решений, обучения и консультирования.

А вы уже пробовали работать с ИИ? Делитесь в комментариях своим опытом составления промптов!