Искусственный интеллект

Может ли нейросеть сделать прототип популярной социальной сети или любой твоей идеи за 15 минут с нулевыми вложениями?

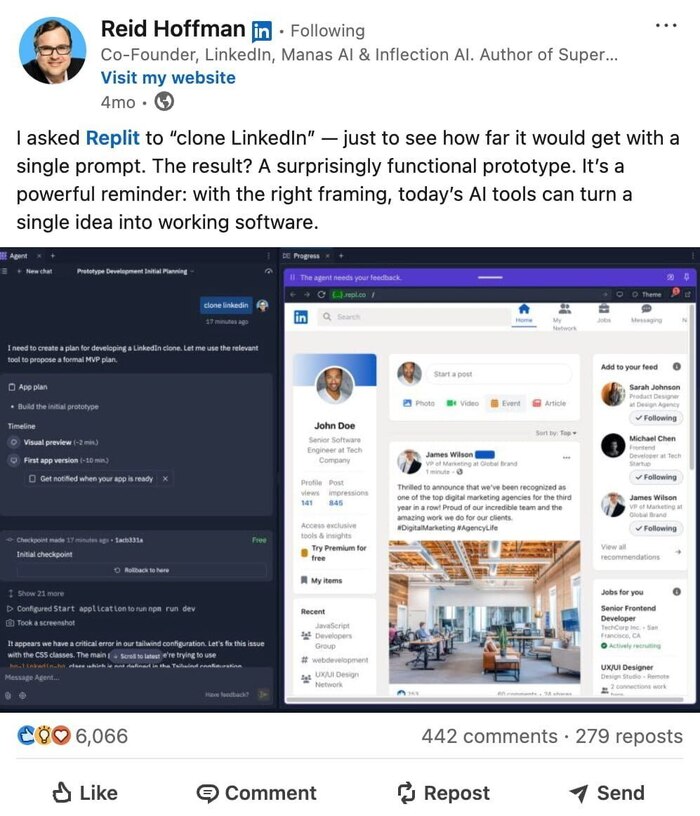

На днях я публиковал на VC пост о том, что основатель LinkedIn восхитился результатами работы нейросетей. Его зовут Рид Хоффман, и он утверждал, что сделал "клон" своей соцсети благодаря нейросетям. Мой пост об этой новости набрал предостаточно обратной связи в комментариях. Но многие усомнились в возможностях такого "клона" и хотели видеть получившийся результат. Справедливо. К сожалению, Рид Хоффман не опубликовал этот проект в публичный доступ. Поэтому я повторил все его шаги и создал прототип LinkedIn с помощью нейросетей и вместо него выложил проект в публичный доступ

🔗Ссылка на демонстрационный проект: https://danilashevchenko.github.io/LinkedIn-Prototype/

🔗Ссылка на репозиторий GitHub с кодом от ИИ: https://github.com/danilashevchenko/LinkedIn-Prototype

В получившемся варианте я специально сам ничего не менял и не улучшал для полноты картины. Конечно, получился всего лишь прототип, и в нем много ошибок. И прототип очень далек от качественного продукта. Но факт в другом. На создание такого проекта ушло не более 15 минут. Загрузил получившийся проект я в GitHub Pages, то есть и создание, и публикация проекта вышли в 0 рублей. По сути, любой человек, который умеет кликать мышкой и печатать на клавиатуре (больше мозгов не требуется), может создавать проекты по своим идеям, чтобы протестировать гипотезу по бизнесу, учёбе или работе буквально за 10–15 минут

Создание таких ИТ-продуктов без программирования называется вайб-кодинг. Я ещё в апреле этого года делал подборку инструментов для вайб-кодинга. Подборка здесь. Почти все инструменты дают возможность бесплатно создавать и тестировать проекты. Конкретно я использовал replit.com, поскольку его применял Рид Хоффман, когда создавал свой "клон" LinkedIn

Пишу о применении и влиянии новых технологий на бизнес и повседневную жизнь в канале Telegram: https://t.me/+NimdslpY9WU0MDYy

Сиди в облаке, сынок

Джеффри Хинтон, «крестный отец ИИ», сократил свой прогноз по AGI с 30-50 лет до «нескольких». А чтобы ИИ нас всех не прихлопнул, предлагает заложить в нейронки материнский инстинкт по отношению к людям: «Помощника можно уволить. Мать — нет».

Интересно, как у Хинтона с фантастикой — там все это уже было.

В Alien ИИ-мать пожертвовала собственным экипажем.

В I Am Mother робомать сжигала детей, не прошедших тест.

В Raised by Wolves от крика ИИ-мамочки людей разрывало на куски.

В System Shock 1-2 киборги и мутанты зовут Шодан «мамой».

В Portal, Mass Effect, в книгах Артура Кларка и Айзека Азимова встречаются ИИ, которые де-факто ведут себя как матери по отношению к людям.

Если в ИИ можно заложить материнский инстинкт, почему не попробовать другие, более удачные модели отношений?

— ИИ-опекуны как в мирах Йена Бэнкса: сверхинтеллекты дружелюбны (за исключением некоторых раздражительных экземпляров) и не стремятся доминировать.

— Конституционный ИИ (как у Anthropic): поведение задают публичные принципы.

— Красные линии: при срабатывании — жесткое стреноживание ИИ.

— Сдержки и противовесы между ИИ: конкурирующие взгляды и взаимный контроль. В фантастике встречается в Terminator, Horizon, Halo, Destiny.

Достаточно продвинутая модель может обойти ограничения, поэтому самой разумной выглядит система сдержек и противовесов.

Однако против алармистов есть сильный аргумент. Любой когнитивный агент сталкивается с проблемой целей: зачем это все? Биологическими организмами движут инстинкты. Люди часто теряют цели, едва закрыв базовые потребности. Это показывает взрыв индустрии развлечений и падающая рождаемость.

Для более развитых когнитивных агентов проблема целей может быть еще острее. Если целей нет, то чем заняться, кроме заботы о кожаных?

Если кто-нибудь воплотит в жизнь предложение Хинтона, и ИИ-мамы все же появятся, то выражение «отморожу уши назло маме» обретет новый смысл.

— Мам, я хочу бороздить Вселенную.

— Это опасно. У нас уже есть виртуальная вселенная дома.

ИИ-браузер сливает данные

Браузер Comet от Perplexity с агентным AI оказался катастрофически уязвим для кибератак.

--

Мой тг-канал: ИИ by AIvengo, пишу ежедневно про искусственный интеллект

Исследование: В США 16% сотрудников притворяются, что используют ИИ

При этом, 59% сотрудников используют ИИ-инструменты ежедневно, при этом 22% людей испытывают психологическое давление применять технологии в ситуациях, выходящих за рамки их компетенций.

9% сообщают о негативном влиянии ИИ на их профессиональную самооценку, а 56% работников инвестируют личные средства в премиум-версии ИИ-платформ, расходуя в среднем $68 ежемесячно на расширенные функциональные возможности.

При этом, культура «обязательной инновационности» создаёт давление, где отказ от использования ИИ интерпретируется как маркер профессиональной некомпетентности независимо от объективной целесообразности.

Кстати, на бизнес тоже оказывается это давление, не только сотрудники страдают. Все хотят ИИ и все не знают, что с ним делать. 🤯

--

Мой тг-канал: ИИ by AIvengo, пишу ежедневно про искусственный интеллект

Qwen добавили в своего чат-бота ИИ-редактор фотографий

Новый нейрофотошоп: Qwen добавили в своего чат-бота ИИ-редактор фотографий. И он работает.

Надо просто загрузить картинку и написать текстовый промт. Нейронка сама поймет, где находится объект для редактирования, и выдаст результат уже через минуту.

Пользуемся бесплатно в чат-боте. (https://chat.qwen.ai/?inputFeature=image_edit) Можно даже не заходить в аккаунт.

Создатель генеративного ИИ в Google призвал отказаться от медицинского и юридического образования

Джад Тариф, который основал подразделение GenAI в Google ещё в 2012 году, выступил с радикальным заявлением.

В интервью изданию Futurism он категорически не рекомендовал инвестировать время и ресурсы в медицинское или юридическое образование, прогнозируя полную автоматизацию данных профессий к моменту завершения университетских программ.

Джад предполагает, что к 2030-2033 годам ИИ-системы настолько продвинутся в своих возможностях, что смогут выполнять основные функции врачей и юристов с эффективностью, превосходящей человеческие возможности.

Вот что он еще добавил:

Я не думаю, что кому-либо вообще стоит получать высшую научную степень, если только он не одержим своей областью. Так что либо уходите в малоизученные ниши типа AI для биологии, либо просто не идите вообще никуда.

"Не получайте степень, если не одержимы" — отличный совет от человека с степенью, работающего в компании, нанимающей только людей со степенями.

А вообще, заявление Тарифа отражает технократический нигилизм: отрицание ценности человеческого знания перед лицом машинного интеллекта.

Но медицина и юриспруденция — это не только техническая экспертиза, но и моральная ответственность. Может ли ИИ нести ответственность за жизнь или свободу человека?

--

Мой тг-канал: ИИ by AIvengo, пишу ежедневно про искусственный интеллект